第412回:ヤマハのしゃべれる「VOCALOID-flex」とは?

~VOCALOIDの生みの親に聞く、開発の経緯と今後の展開 ~

|

| ヤマハ 研究開発センター グループマネジャーの剣持秀紀氏、同研究開発センター ネットビジネスグループ主任の木村義一氏、同研究開発センター 技師補の小山雅寛氏(写真右から) |

Y2 SPRINGで発表された技術として、これまで「クラウド型VST」、「NETDUETTO」のそれぞれの開発者インタビューを行なってきたが、今回はその第三弾として、VOCALOID-flexの担当者にお話を伺い、VOCALID-flexとはどんなもので、従来のVOCALOIDとどう違うのか、今後の製品展開をどう捉えているのかなどを聞いた。

お話を伺ったのはVOCALOIDの生みの親であり、たびたびメディアにも登場している、ヤマハ 研究開発センター グループマネジャーの剣持秀紀氏、同研究開発センター 技師補の小山雅寛氏、同研究開発センター ネットビジネスグループ主任の木村義一氏の3名。(以下、敬称略)

■ VOCALOID-flex開発のキッカケとは?

藤本:先日のY2 SPRINGでは、初音ミクが普通にしゃべているのを聴いて、驚きましたが、このVOCALOID-flexというものどんな経緯、キッカケで開発することになったのですか?

|

| ヤマハ 研究開発センター グループマネジャーの剣持秀紀氏 |

剣持:ニコニコ動画などを見ているとVOCALOIDを利用した“しゃべり”を投稿する人を多く見かけるようになりました。みなさん音符を並べて、ピッチベンドを利用したりしながら、一生懸命作品づくりをされており、すばらしい作品も数多くあります。でも、それって非常に非直感的な操作をしているのだろうなということが、ひしひしと感じられます。

間接的な操作・作業をしているのだろうけれど、きっと本当はもっと直接的にイントネーションの操作をしたいだろうに……と思うことがしばしばでした。一方、曲作りにおいても、より感情がこもった歌に仕上げるために、さまざまな工夫が凝らされています。やはりピッチベンドなどを利用しつつ、作られているわけですが、たぶん、まどろっこしいだろうな、と。

藤本:確かに、みなさんいろいろな調教をされていますよね。職人的な作業をされていますが、誰もが簡単にしゃべらせたり、より抑揚ある歌を歌わせることができる状況ではありません。

剣持:VOCALOID2では、ベロシティで子音の長さを変えられるようにしています。でも、もっと自由度が欲しいだろうな、とは思います。またイントネーションを自在に操れるようにしたり、音素の長さを直接いじれるようにしたら、しゃべりや曲の調整も楽になるだろうなと思っていました。とはいえ、世の中には非常に完成度の高いテキスト音声合成(TTS:Text to Speech)というものがあるので、それと張り合っても仕方がないという思いもありました。

■ 歌に近いしゃべりを目指して

藤本:TTSとVOCALOIDでは、音声合成の方法がだいぶ違うのですか?

剣持:そうです。いまTTSでは大規模なコーパス(自然言語の文章を構造化し大規模に集積したデータベース)を利用し、入力した文章の中から一番近いものを近いものをコーパスの中から持ってきてつなげるという方法をとっています。たとえばATR(国際電気通信基礎技術研究所)のCHATRといったものが有名です。

これは非常に素晴らしいできで、ナレーションならナレーションの雰囲気までも出すことができます。声質も加工せずにペタペタと繋いでいくので、生々しい音声ができあがるのです。以前、発表していた面白い事例として、黒柳徹子さんが読む天気予報というものもありました。これは、黒柳さんが朗読したある脚本をコーパスとして利用し、テキストで与えた天気予報を読ませるというものです。非常にリアルで、ネット上でも聴くことができますよ。ただ、こうしたTTSは朗読の分野。いまさらヤマハでこれを目指しても仕方ありません。やはり、「歌」に近い分野でのしゃべりを実践させたいと思ったのです。

藤本:歌に近いしゃべり、とはどういうことですか?

剣持:たとえば「いってきま~す!」、「900円で~す」など、同じ喋りでも人によって、またその場の状況によってイントネーションは大きく変化します。TTSの場合、コーパスの中にたまたまそのイントネーションのデータがあれば、再現させることができますが、現実的には難しいでしょう。またイントネーションを自在に変化させるといったことはできません。それに対し、われわれは歌から入ってきたので、もっと自由自在にしゃべらせることが可能なはずだ、と。

藤本:確かに、すでにサンプリングしたフレーズを切り貼りしていく方法では、イントネーションを変えたり、「いってきます」を「いってきま~す!」と変えることは難しそうですね。

剣持:もっとも、古い方式の分析合成技術であるLPC(Linear Predictive Coding:線形予測符号)を用いた音声合成では、そうしたことはできたんですよ。つまり自由自在に韻律、イントネーション、音素の長さを与えるのはできました。

ただ、ボコーダーのようなモゴモゴした音で、しゃべりとしては聴き取りにくいものだったのです。それに対し、VOCALOIDの処理ならリアルな音が出せるはずだと考えました。VOCALOIDを少し改良して、音素の長さ、音のピッチを直接指定できるようにすれば、自由自在なしゃべりを実現させることができます。だから、朗読ではないところを狙ってみようと考えたわけです。

藤本:その改良というのは、かなり難しいものなのでしょうか?

|

| CEATEC JAPAN 2009で、「HRP-4C 未夢(ミーム)」が、VOCALOIDで歌いながらのピアノ演奏を披露した |

剣持:技術的にはそれほど難しいものではありません。従来のVOCALOIDの音声合成では音符をもとにピッチのカーブを作るとともに、音素を組み合わせることで歌声を作り出していました。しかし、音符から作るのではなく、VOCALOIDに横から穴を空け、直接ピッチの変化や音素の長さを指定することで、フレキシブルなしゃべりが実現できるのです。

このようにVOCALOIDに柔軟性を与えているので、VOCALOID-flexと名づけたわけです。このVOCALOID-flexを用いて作ったデモをひとつ聴いてみてください。これは私の所属する清水フィルハーモニー管弦楽団というアマチュアオーケストラの演奏会の「語り」に実験的に使用した例です。「えー、まさかー、ソルベーグ! おやすみ私の愛しい子。ずっとずっと見守ってあげる」としゃべっているのですが、どうですか?

「えー、まさかー、ソルベーグ! おやすみ私の愛しい子。ずっとずっと見守ってあげる」 |

藤本:これは、すごいですね。ハッキリと聴き取れて、すごく抑揚もついています。

小山:このVOCALOID-flex、発表は2月25日でしたが、その声自体は昨年のCEATEC JAPAN 2009で披露しました。独立行政法人産業技術総合研究所のヒューマノイド・ロボット「HRP-4C 未夢(ミーム)」が、VOCALOIDで歌いながらピアノを演奏するというデモを行ないました。そのデモの前に「○○さん、リクエストありがとうございます」といったしゃべりをしていました。実はそのしゃべりがVOCALOID-flexによるものだったんです。

■ いろいろな入力方法で、自在にしゃべらせる

藤本:なるほど、CEATECですでにデビューしていたんですね。でもこのしゃべり、どうやって入力するのですか?

剣持:そのユーザーインターフェイスは、従来のVOCALOIDのものとは大きく異なるので、一から作ることになりました。あくまでもプロトタイプという形のエディタではありますが、いろいろな入力方法を持たせています。

すべて自分の手でピッチの変化や音素の長さを指定していくこともできますが、録音したWAVデータを元にピッチを取り出して合成する機能をこのエディタには搭載させています。これに「かな文字列」を入力することで、音素を指定していくことができます。一応、「漢字かな混じり文字列」を指定することもできますが、辞書部分をそれほど充実させていないため、あまり機能的な完成度は高くありません。

|

| of0101.mp3(14.6KB) |

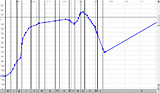

WAVデータを利用するのが便利なので、実際に試してみましょう。私の声で「おはようございまーす」と波形編集ソフトで録音してWAVファイルを生成し、これをVOCALOID-flexのエディタに読み込ませ、「おはようございます」とかな文字列を入力します。すると、ピッチの変化が、エディタ上に反映されるようになっています。これを再生させると、いま録音したとおりのイントネーションで初音ミクがしゃべってくれるというわけです。

藤本:本当に、いま録音したとおりのイントネーションですね。エディタの画面上には「miku」と表示されていますが、これは特殊なデータなのでしょうか?

|

| of0201.mp3(14.6KB) |

剣持:いいえ、現在発売されている初音ミクのデータそのものです。ここで、マウスを使ってピッチを少し変えてみましょう。どうですか?少し強調されたしゃべりになりましたよね。

藤本:このVOCALOID-flex、パラメータ的には何があるのでしょうか?

剣持:まず、画面下に表示されているアルファベットである音素です。また音素がどのくらいの時間であるかが調整可能となっており、これを音素長と呼んでいます。そして音の高さ=ピッチです。

|

| ヤマハ 研究開発センター 技師補 小山雅寛氏 |

小山:それに音量もあります。このエディタでデフォルトでは表示されていませんが、別レイヤーで音量も表示させることができ、これを変化させることで表現力も増すようになっています。そのため音素、音素長、ピッチ、音量の4つのパラメータがあるわけです。

ただし、日本語でも英語でも音量はしゃべり方のアクセントに大きな影響を与えないため、主には3つのパラメータをいじっていけばいいと思います。もうひとつ、VOCALOID-flexの新しい機能として追加されているのが、母音の無声化や脱落化です。無声化とは母音を無声音として発音するケース(例:北[ki ta]の[i])、脱落化とは母音を発音しないケース(例:~です[de su]の[u])です。こうした機能によってしゃべったり、歌ったりする表現方法も広がります。

藤本:なるほど、こうしたエディタがあれば、かなり自在にしゃべらせることが可能ですね。でも、歌の場合はどうすればいいのですか?

剣持:VOCALOID2 Editorに音素の長さとピッチの長さを出力できる機能が実装されれば、それを使って修正するということも考えられます。伸ばしている音のピッチを波打たせればビブラートになりますよ。このプロトタイプのVOCALOID-flexのエディタにはビブラート機能といったものは用意されていないので、マウスを使って描いていかなくてはなりませんが、ぜひそうしたエディタを開発してくれる企業が現れてくれればと思っています。

■ 一般ユーザーが使える機会も検討

藤本:Y2 SPRINGでの発表後、企業からの引き合いは来ているのですか?

小山:はい、いろいろなところからオファーをいただいています。われわれはエンターテインメント市場での利用を想定していたのですが、結構ビジネス用途で使いたいといった要望も寄せられて、少し驚いているくらいです。

|

| ヤマハ 研究開発センター ネットビジネスグループ主任 木村義一氏 |

木村:淡々とした朗読と違い、イントネーションをつけられることから、用途が広がっていきそうです。たとえば工事現場などでは、ハッキリとした抑揚があるほうが目立って、アラートになるわけです。今度は私が試してみましょうか。

先ほどと同様に「右に曲がりますよー」というフレーズで入力すると……、このように初音ミクがしゃべってくれます。ここで最後の「よー」のピッチをいじると、雰囲気が変わります。

|  |

| 「右に曲がりますよー」 mf101.mp3(15.6KB) | 「よー」のピッチをいじる mf0201.mp3(17.7KB) |

藤本:ぜひ、すぐにでもVOCALOID-flex使ってみたいのですが、これはどんな形で世の中に登場してくるのですか?

|

| METAL GEAR SOLID PEACE WALKER (C) 2010 Konami Digital Entertainment |

木村:まずは、Y2 SPRINGでも発表したとおり、PSP向けゲーム「METAL GEAR SOLID PEACE WALKER」がKONAMIから4月29日に発売されます。これは1年以上前からレコーディングに取り組むなど準備してきたものだったので、ようやくここまで漕ぎ着けたという思いです。ほかにもまだ明言はできませんが、いくつかのプロジェクトが進んでいます。

藤本:個人的にはやはり、VOCALOID-flexのエディタを自分で使って直接、しゃべらせたり歌わせたりしたいですね。

小山:現在のエディタは、あくまでもプロトタイプであり、このままみなさんに使っていただくという考えはありません。このプロトタイプは、先ほどお見せしたような編集機能のほか、XMLでデータを吐き出すといった機能も搭載させるなど、いろいろな可能性を示すものにはなっていますが、誰もが使えるものに仕上がっているわけではないので、あくまでもtoBの用途でしか使えません。

剣持:将来的にはtoCを当然、考えていきたいのですが、今ののところ具体的な計画があるわけではありません。とはいえ、なんとかみなさんに使ってもらえる機会を作ってはいきたいので、ひょっとしたら、どこかでβテストみたいなこともあるかもしれません。

木村:VOCALOID-flexをNetVOCALOIDと組み合わせるといったこともあるかもしれません。たとえばエディタは広く配布した上で、サーバー上のNetVOCALOIDで音声合成を行い、その際に課金するといったビジネスも考えられそうです。

藤本:いずれにしても、早く一般ユーザーが利用できるようになることを期待しています。本日はありがとうございました。