第159回:CES特別編 Kinect風操作が次世代TVに?

~パナソニック新プラズマやmirasolなど~

2012 International CES特別編の最後は、映像機器関連とその周辺技術の展示で興味深かったものを紹介する。

■ パナソニックの'12年版プラズマ

|  |

| 液晶とプラズマを均等にアピールするパナソニック。大画面高画質はプラズマという立ち位置は維持していく | |

2012年のパナソニックは、液晶テレビで55/47型の大型製品を市場投入する戦略を発表した。これは、「大型テレビをプラズマテレビに、42型以下を液晶テレビに」と切り分けて製品化してきたこれまでのテレビ戦略を辞めるということだ。となれば気になるのが、今後のプラズマの動向だ。

実際、今回のCESを取材してみた感じでは、パナソニックのプラズマ(PDP)関連の新技術展示は、他のどこのメーカーよりも詳細であり、PDPへの力の入りようは昨年から衰えは感じられない。もっとも韓国勢はプラズマに対しては今や腰引け気味であり、本気でやり続けているのはパナソニックのみ、という状況がそう感じさせているのかもしれないが……。

パナソニック関係者に取材したところでは、2012年度のPDPも完全新設計で、統合された元パイオニアのPDP開発チームとの技術コラボはさらに深度を増したとのこと。

新PDPは、予備放電を一層低減して黒画素の発光量をさらに削り取ることでさらに黒の沈み込みを加速させ、暗所コントラストはパイオニアのKUROを完全に凌駕するものとなった。

元々、KUROは漆黒のゼロIRE状態からの立ち上がりこそ高速だったが、その発光レベルに関しての精度がやや甘めでS/Nが芳しくない局面があったが、これはパナソニックの技術で解消。トータルな画質性能が向上したという。まさに2012年PDPは、パナソニック×(元)パイオニアのコラボの究極パネルといったところか。なお、パナソニックは、今回の極まった黒表現特性に対して「Infinite Black Ultra」というブランド名を付けている。

|

| 左が2011年モデル、右が2012年モデル。写真では違いがわからないが、肉眼では、'12年モデルの方が一段上の黒が表示できていることがよくわかった |

2012年のPDPでは、2つの大きな改良点が盛り込まれる。

1つは同一消費電力で1.5倍に高められた輝度性能だ。これは新開発の短残光蛍光体、画素セル内に封入される希ガスのレシピの進化、異形サイズのサブピクセルなどによって実現されている。ただし、この1.5倍に高められた輝度性能は「表示を明るくする」と言うことに利用するだけでなく、階調生成のためのサブフィールド生成を高速化するという向きに応用する。

プラズマは各画素のカラー表現をいわば明滅頻度で表現する時間積分型階調(カラー)生成を採用している。つまり、人間は、その明滅パターンを始まりから終わりまで見続けないと正しい色が人間の目(というか脳)に知覚されない。ただし、動画を見ているときなど、人間の目は画面内を動くので、ある画素において正しい色が知覚される前に別の画素を見てしまい色割れや擬似輪郭、あるいはボケを知覚してしまう。プラズマは応答速度はいいといわれるが、実はプラズマのカラー表現の視覚感は個人差があって上記のようなアーティファクトを感じやすい人たちがいる。筆者などはまさにそうした人間の一人だ。

これを解決するにはサブフィールドによる時間積分的カラー表現に掛かる時間を狭める(短縮する)ことが直接的なアプローチとなる。今回はそれを行なったというわけだ。つまり、輝度が1.5倍(3/2倍)に高められたのだから、これまで1の時間内で輝度1で光らせていたものを2/3の時間内で輝度1で光らせる、というようなアプローチで改善したというわけだ(あくまで分かりやすくするための例え話だが)。

2つ目の改善は、サブフィールド駆動に人間の視覚モデルと動画特性に配慮した適応型のアルゴリズムを応用する工夫だ。

「人間は動画を目で追う」と上で述べたが、2012年PDPは、この特性に配慮したサブフィールド駆動を行なうというのだ。

これまた概念的な例え話になるが、ある画素が移動している場合、現在位置と次の移動先位置の二箇所で「正しく適切な画素として"人間が見える"」ようにサブフィールドを生成するのだ。いわば各画素の移動ベクトルに配慮した誤差拡散的アプローチとでも言うべきか。

|  |

| 2012年PDP、第1の進化ポイント | 動画特性に合わせてサブフィールドを生成して駆動する「2500 Focused Field Drive」。仮想的には0.4ms(400μs)でサブフィールド駆動が完了 |

パナソニック関係者によれば、この新駆動は映像エンジン側ではなく、プラズマパネルの駆動回路側で行なわれるとのことなので、それほど高度な制御ではないのかも知れないが、発想の方向としては液晶テレビの残像低減技術の補間フレーム挿入と似ていると言えるかも知れない。

こうした工夫により、「2012年PDPのサブフィールド駆動は"仮想的に"0.4msにまで短縮出来た」とアピールされている。"仮想的"というのは2番目の工夫が介入しているからだろうが、いずれにせよ、0.4msでサブフィールド駆動が完了するのであれば、これはもはや時間積分型カラー生成という必要も無いほどに高速だといえる。

|

| 左が従来モデル、右が新PDP。左右にスクロール移動する映像のディテールの違いが比較できるデモ。プラズマはシャッター速度を上げすぎると色落ちするので1/30sで撮影。そのため写真では分かりにくいが、新PDPの方が移動映像であっても高周波のテクスチャ感が維持できていた |

パナソニックでは0.4msが「1秒の2,500分の1」であることから、この駆動方法を「2500 Focus Field Drive」と命名してブランディングしている。

実際にデモ映像を見た限りでは、高速横スクロールしている映像であっても、擬似輪郭は見えないし、色割れも感じられなかった。やや頭打ちになりつつある液晶と違い、PDP画質はさらに進化したという実感がある。その実力はいずれ、本連載でも検証してみたいと思う。

この他、パナソニックの2012年モデルのプラズマVIERAには、下部が太るボディデザインを改める薄さの均一化の改良、下部設置のスピーカーからの音像定位を画面中央に持ち上げる工夫が盛り込まれる。

|

| 左右にスクロール映像で液晶VIERAの動画特性を比較。左か従来機、右が2012年モデル。実際に見た時の見え方はくっきりと映像のディテールが見える |

55インチまで拡大された2012年の液晶VIERAに関しては、水平8分割スキャニング表示と4倍速240Hz駆動を合わせた1,920(=240×8)バックライトスキャニング(bls)駆動技術を盛り込んでいくことがアピールされていた。

“1920bls”という数値に、どの程度の説得力と訴求力があるのかは正直分からないが、実際に横スクロールのテスト映像を見た限りでは、文字周辺のボケ味などはとてもうまく低減され、くっきりと見えていた。こちらも実際の製品で、実際の映像コンテンツを表示したときにどのような画質になるのかは興味があるところだ。

価格帯的には55型液晶の方が55型プラズマよりも安価に設定されるとは思うが、いずれにせよ、一般消費者は同画面サイズVIERAを選ぶ際に「液晶かプラズマか」を選択することになる。マーケティング的には、プラズマは2012年が正念場か。

|  |  |

| 上が新開発の55型IPSα液晶パネル。斜めから見ても色味の変化が少ないというデモ | 上が55型IPSα液晶。黒の締まりや発色の違いに注目。写真でも違いが分かるレベルの進化だ | 仮想1920Hz駆動をアピールするパナソニック |

■ Kinect風のジェスチャー認識がテレビの操作系を変える?

次は3Dの話題を。といっても、3Dは3Dでも「見る3D」ではなく「操る3D」の方。「テレビを操る3Dインターフェース」が、今年のCESでは人気のテーマであった。

テレビやPCのユーザーインターフェイスを3D化する、というとイメージが湧きにくいかもしない。噛み砕いて言えば、ユーザーのジェスチャーで機器をコントロールしようというアイディアのことだ。

展示されていた全てに共通するのは、どこもマイクロソフトのXbox360用Kinectのようなデバイスを用いるという点。

|

| SoftKineticsの測距イメージセンサ「DepthSense」 |

ベルギーのSoftKineticは、2008年頃からこうしたモーション入力システムの研究開発に従事してきた新興メーカーで、SoftKinecticスタッフによれば、Kinectよりも認識精度が高いのが特徴だという。

イスラエルのPrimeSenseが開発した技術ベースのKinectは事前に用意したドットパターンを赤外光で照射して、そのドットパターンの変形からシーンの形状を認識する方式だ。一方、SoftKineticでは赤外光を上下左右90度の範囲に面照射して、その反射光が帰ってくるまでの時間をCMOSベースの距離イメージセンサでTOF(Time of Flight)方式で測定する。TOFとは、照射された赤外光が反射されて照射側に戻ってくるまでの時間差でシーンの深度分布を計測する手法。ここがKinectよりも精度が高くなるキモになっており、細かい指の動きまでを取得できるという。

なお、Kinectと同じく、同時に可視光映像(いわゆる普通のカメラとしての撮影映像)を取得しており、シーンの対象物を認識し、それが人であれば、取得した赤外光ベースのシーンの深度情報と組み合わせて、ボーン(骨格)を取得したり、あるいはボリュームデータを取得したりするという後段のプロセス自体はよく似たものになる。

ブースでは、競合のKinectでは難しい、指の動きを使った人形劇のデモや、人体の動きをリアルタイム取得してCGキャラクターに反映するリアルタイムモーションキャプチャー技術などをデモしていたが、セットトップボックスやスマートTVなどの操作インターフェースへの技術提供にも力を入れているのだとか。

現在、ハードウェアとソフトウェア開発キット(SDK)付属のフル版が499ドルで発売中で、近々モデルチェンジも予定されているとのこと。

現行型のDS311はQQVGA(160×120ドット)の深度解像度、640×480ドットの可視光カメラ解像度で60Hzのキャプチャが可能だが、新型(OEMになる予定)はQVGA(320×240ドット)の深度解像度、1,280×720ドットの映像解像度での60Hzキャプチャが可能になるという。

|  |

| 現行型SoftKinect深度センサ。こちらは発売中 | 新型SoftKinect深度センサ。こちらはOEMブランドでの発売になる見込み |

ところで、これまでは無名だったSoftKineticだが、2011年には彼らをとても有名にした大きな契約があった。それはLenovoが中国発売を計画中の家庭用ゲーム機「iSec」向けの技術として同社の技術を採用したことだ。

これをステップにして、彼らはさらに家電業界やデジタルサイネージ業界にも進出していきたいと熱く語っていた。指の動きが正確に取れるというのは、確かにAV機器などの操作系に役立てられるかもしれない。

|  |

| リアルタイムモーションキャプチャーのデモ | |

|  |

| デジタルサイネージ分野への応用として示していたのは「前にいる人の動きを真似する人形」デモ。指の動きまでが取れるのが強みだという | |

|

| LGのGesture Cam。技術提供元を明かしていないが、赤外光ドットパターン照射レンズと赤外線/可視光カメラの位置関係などを見る限り、PrimeSenseのものと思われる |

実際に、こうしたモーション入力システムの製品採用を直近で検討しているメーカーがある。それはLGエレクトロニクスだ。

ブースでは「Gesture Cam」と名付けられたモーション入力センサーをテレビ下に設置し、ユーザーのモーションで落下物を破壊するパーティゲームのようなものが楽しめるようになっていた。

今回のデモはPCベースでの実装となっていたが、LG関係者は、同社の新チップセット「L9」ベースのスマートTVでの実装を目指して開発が進行していると述べていた。このセンサー自体をテレビへ組み込むのか、別体型で提供されるのかは不明だとのこと。

「本当にこんな突飛なものをテレビに統合するのか」と思う人も多いだろうが、LGは実際にWiiリモコンのような赤外線ベースのポインティングデバイス型リモコンを「Magic Remote」として製品に統合した実績を持つ。しかも'12年モデルはMagic Remoteは2世代目となり、今度は音声入力に対応しているのだから、このKinect風システムが実際に製品化されても不思議ではない。

|  |

| ブースではスマートTVでモーション入力ゲームがプレイできるようになるとアピール | 「Magic Remote」はスマートTV向けコントローラとして製品化された。GestureCamも来年には? |

このブームの火付け役の本家本元(?)、PrimeSenseのブースを訪れてみたところ、スマートTV向けのモーション入力インターフェースのプレゼンテーションを行なっていた。PrimeSenseはハードウェアやゲーム関連技術だけでなく、こうした汎用UI技術の提供にも進出したというわけだ。

実際に筆者もモーション入力システムベースのテレビUIを体験さてせもらったが、腕を動かす、つまむ、放すといった動作と、「COMMAND-PLAY」といった音声コマンドで、テレビの操作がスピーディに行なえることが確認できた。一見すると仰々しいUIシステムだが、慣れると意外に使いやすい。何よりリモコンを探さなくて済むのがいい。

PrimeSenseの担当者によれば、「Xbox 360のKinectに技術供与したおかけで量産効果も上がって、低コストに光学ベースのモーション入力技術が提供できるようになった」とのこと。これがテレビなどへの組み込みビジネスへの進出を決めた要因のようだ。

競合のSoftKinectはたまたま近くにブースを出していたこともあって、PrimeSense担当者は「我々のものは、競合他社のものよりも1/3以下の原価コストで済む点が圧倒的に有利だ」と強くライバル心を燃やしていたのが印象的であった。

どうやら、こうした状況を見ると、Kinect的なモーション入力UIを採用したテレビ製品の市場への登場は予想よりも早いかもしれない。日本勢も、東芝などがモーション入力システムを応用したテレビUIを研究開発していたはずだが、海外勢のこうした動きに追従していくのかも気になるところだ。

|  |

| 現在、Kinectと同等のモーション入力システムのPC版が「PrimeSensor」としてPrimeSenseの直販サイトより150ドルで発売されている。近日中にASUSブランドのOEM品も発売予定 | |

|  |

| Kinect技術の生みの親、PrimeSenseは、この技術をテレビ向けのUIへと売り込み中 | |

■ 蝶や孔雀の羽の色彩原理を応用したディスプレイがついに5.7インチで実用化

液晶でも有機ELでもプラズマでもない「IMOD」ディスプレイは、QUALCOMMが6年間も研究してきた新しい映像パネルだ。IMODとはInterferometric Modulatorの略で、直訳すると「光干渉変調」ということになる。

|  |

| mirasol採用の電子ブックリーダー「BanBook SunFlower」は1月発売予定。価格未定 | 中国市場専用の「Hanvon c18」もmirasol採用の電子ブックリーダだ。こちらは北米価格にして300ドル程度で2月に発売が予定されている |

このIMODディスプレイは、「mirasol」というブランド名が付けられており、電子ペーパー(eペーパー)ライクな低消費電力フルカラーディスプレイとして訴求されている。

mirasolディスプレイの根幹技術はMEMS(Micro Electro Mechanical Systems)になるが、その動作原理はなかなか独創的だ。そもそもの着目点は「蝶や孔雀の羽は自発光でもないのに、なんであんなに鮮やかなのか」というところにある。

蝶や孔雀の羽は、やってきた入射光が羽の表面上の薄膜で干渉し、そこで反射光が特定色に変換されて出射されるので鮮やかに見える。白色光から特定色の光を濾過して取り出すようなカラーフィルター構造も用いないので光の利用効率もいい。

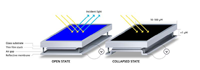

この動作原理を電子的に制御して作り出そうというのがmirasolディスプレイの基本的なアイディアになる。

mirasolの画素は表示側に薄膜をコーティングした透明な硝子基版を配し、その下に薄いフィルムが取り付けられ、僅かなギャップを開けて最下段には導電性の反射膜が配された構造をとる。

入射光は、このギャップを通り、ギャップと最上部の薄膜と反射膜との干渉で光の波長がシフトし、ある想定された単色となって反射する。これがカラー(ただし単色)の発生メカニズムだ。なお、その単色はギャップ幅や薄膜の特性を変えることで設計する。フルカラー表現を行なうには赤、緑、青(RGB)の単色から成るサブピクセルを構成することになる。

ここで電圧をフィルム側と反射膜にかけると静電効果により反射薄膜が浮き上がりギャップを埋めてしまう。この時、外からの入射光は光の干渉現象で波長が紫外線領域にシフトしてしまい可視光でなくなることから黒表示となる。

このままではmirasolは「黒」か「単一カラー」の二色しか出せないことになり、フルカラーは出せない。そこで「単一カラーか黒か」の二色しか出せない単色サブピクセルを複数用意して、階調を作り出すアプローチをとる。例えば図のように14個の赤の単色サブピクセルを用意すれば0~14個の15段階の単色赤階調が作り出せることになる。

|  |

| 波長を変調して発色するので透過光を選別してしまうカラーフィルタ方式よりも発色効率は高い。また黒表示も反射光を紫外線にシフトしてしまい可視光を返さないので、黒は印刷された紙の黒に近い漆黒となる | 原理上サブピクセルは黒か単一カラーのどちらかに限定されてしまう。よってフルカラーを出すには1ピクセルあたりRGBのサブピクセルを複数個用意する必要がある |

筆者が初めてmirasolディスプレイを見たのは今から5年ほど前で、そのころは1インチ台の大きさの試作パネルしかなかったが、今回のCESの展示では5.7インチサイズの1,024×768ドットの解像度のパネルを採用したAndroidベースの電子ブックリーダを公開していた。

実際に映像を見てみたが、解像度はかなり高く文字もきめ細やかという印象を持った。mirasolは原理上、反射型ディスプレイであるため周囲が明るければ明るいほどよく見える。屋内だとやや暗く見えてしまうが、これを補うために展示されていた電子ブックリーダーはエッジライトでmirasolパネルを照らせる構造になっていた。

構造がシンプルなMEMSベースのmirasolは消費電力も低い。QUALCOMM担当者によれば、エッジライト未使用状態のmirasolパネル単体の駆動電圧はわずか1mWだそうで、今回の5.7インチ電子ブックリーダー製品では、満充電状態から最大3週間の連続表示が可能だとのこと。これは確かに凄い。

また、マイクロ電磁メカのMEMSベースなので応答速度はとてつもなく速く、なんと1ms未満のμs(マイクロ秒)オーダーだと発表されている。つまり、動画表示性能にも申し分ないということだ。

|

| 接写撮影したもの。フルカラー表現のためのサブピクセル個数が多く、階調によって画素の見え方が変わるため、やや輪郭がボヤっとした映像になる |

しかし、実際の動画表示を見るとややティアリング(前フレームを消さずにそのまま上書き描画していることが原因と思われる)が視覚されるので、画素応答速度は速くても、現状、ディスプレイパネルとしての"駆動"はあまり動画を想定していないように思われる。ここは今後の課題か。

また、色についても外光を変調して発色する仕組みの関係からか、カラー表示時の色味が外光の影響をうけやすく、室内照明では色あせた写真のようなカラー表示に見えてしまうのが気になる。ここはQUALCOMM担当者もよく分かっているようで「いずれ屋内時のカラー品質は上げたい」と述べていた。やはりカラー品質が上がらないと主流の映像パネルへの昇格は厳しい。とはいえ、まだ若い技術なので今後の進化の"伸びしろ"もあるはずだ。期待したい。

■ ネットワーク対応業務用HMDシステム「ゴールデンアイ」

米ボストンに本拠地を構えるKOPINは、HMDを小型コンピュータと4Gネットワークを組み合わせて、ユニークかつサイバーなシステム(サービス)をVerizonブースにてプレゼンテーションしていた。

|

| KOPINの「Golden-i」 |

「GOLDEN-i」(ゴールデンアイ)という仰々しい名前の付けられたこのシステムは、一見すると、ただの単眼型ヘッド・マウント・ディスプレイ(HMD)に見えるが、実はもう少し高度なものに仕上がっている。

実は、単体で動作可能なWindows CE6ベースの小型コンピュータなのだ。CPUはデュアルコアOMAP3530(ARM CortexA8 600MHz/DSP 400MHz)を採用。装着時に頬あたりにくるディスプレイ部は800×600ドット解像度をもつカラーディスプレイになる。ディスプレイパネル自体は1インチ未満の極小サイズだが、特殊光学系が配置されることで仮想的に50cmほど先に15インチサイズの画面があるように見える。背景は透過せず。視界を邪魔しないために頬あたりにレイアウトされるようだ。

microSDカードスロットを装備し、ネットワークはBluetoothとIEEE 802.11b/gの無線LANに対応。ただし、いずれも"あえて"近距離通信向けのレンジにしか対応しない。これは消費電力を抑える目的と、通信相手は自分の身に付けている機器かあるいは、隣接している相手との通信のみを想定しているためだという。ワイドレンジな通信が必要な場合は、4G通信端末を利用する。主に、Bluetoothや無線LANはこの4G通信端末との連携に利用することになる。重量は約170g。

いってみれば「Golden-i」はウェアラブルコンピュータだ。KOPINスタッフによれば、両手を常に使用できる状態になるため、建築現場、医療、軍事、警備などでの利用を想定しているのだという。

まず、画面に映し出されているウインドウアイテムの操作は音声コマンドで指示が可能になっている。カーソル操作や位置指定のようなポインティング操作に関してはアイトラッキングではなく、首を軽く振るジェスチャー操作によって行なう。ユーザーのジェスチャーは、Golden-iに内蔵された6軸加速度センサーを利用して取得される。

|  |  |

| 装着状態 | ||

KOPINスタッフが強調していたのは、Golden-iに装着されている約50g程度のカメラ(脱着可能)を駆使した視界共有の潜在能力の高さだ。このカメラから捉えている自分の視界をホストコンピュータへリアルタイムでビデオストリーミングできるのだ。他ユーザーの視界をストリーミングし、共有することも出来る。このビデオストリームのin/outにはVerizonの4Gネットワークを使うという。

ビデオストリームの入出力ができ、リアルタイム映像情報がユーザー間で共有できるようになると機動業務の可能性は一気に広がるという。視界が共有できるので、図面を見ながら音声で指示する際には的確な指示が行なえるようになるし、手元にない資料を見たくなったときでも、両手を使わず音声コマンドで即座に引き出すことができる。

|

| カメラユニット |

ブースではGolden-iを装着した被験者がショッピングモールの警備員に扮し、迷子になった子供を見つけ出すという任務の疑似体験が行なえるようになっていた。

まずは迷子の子供の顔をHMDに表示してターゲットを確認。引き続き、ショッピングモールの地図を呼び出してHMDに表示して、複数ある監視カメラの位置を確認する。そして迷子がいそうな場所に近い監視カメラの番号を音声命令で選択すると、その監視カメラの制御が被験者に移り、被験者の命令通りに監視カメラが上下左右(ズームイン/ズームアウトも操作可)に動くようになる。選択した監視カメラで捉えているリアルタイム映像は被験者のHMDにストリーミングされるので、カメラの映像を見つつ、実視界でも迷子が探せるのだ。なんだか体験していると近未来アクション映画の主人公になったような気分になれる。

|  |

| 警備室の本部の画面。迷子の顔写真、そして4台ある監視カメラの映像が出ている。本部は、任意の情報を、各警備員に配信 | 体験では実際にブース内に設置された監視カメラをGolden-i経由で操作することができた |

このGolden-iシステムは設計開発はKOPINが行ない、製造はモトローラが担当。業務用として2012年内の発売が予定されている。評価用の開発キットは2,500ドルで提供されるとのこと。

(2012年 1月 25日)