西田宗千佳のRandomTracking

第626回

iOS 26など「アップルのOS次期バージョン」で起こること。AV目線で見る9つの新機能

2025年7月31日 07:00

毎年秋には、アップル製デバイス向けOSの新バージョンが公開される。そして同様に、7月にはパブリックベータ版が公開され、どのような機能になるかを試すことも可能となる。

パブリックベータ版はあくまでベータ版であり、不具合やローカライズが行なわれていない部分もあるし、機能的に正式版と異なる部分もある。だから多くの方にはインストールをお勧めしない。

だが、どんな機能が増えるのか気になる方もいるだろう。

そこで、パブリックベータ版で確認できる「新OSの機能」のうち、特にオーディオビジュアルに関わるものを、画像とともにご紹介していく。

今回対象となるのは、iOS 26/iPadOS 26/macOS Tahoe/watchOS 26/tvOS 26。これらはパブリックベータが提供されており、今回、報道用に許可を受けてスクリーンショットや動画を利用している。

テスト中につき、秋に一般公開されるバージョンとは画像の細部が異なる可能性があることをご留意いただきたい。

visionOS 26についてはバブリックベータが提供されないので、今回は言及しない。

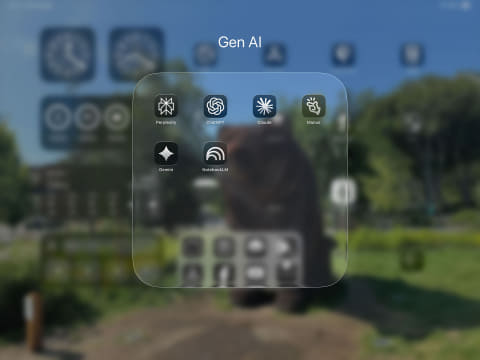

その1:Liquid Glassの価値は

まずは、一般的な変化である「UI」から。visionOSを除く各製品では、今回から「Liquid Glass」というUIデザインが採用される。

Liquid Glassでは「ガラスのように透明なものを重ねた」という表現がなされるが、実際にはけっこう印象が違う。「光の透過とハイライトを強く活かしたUI」といった方が正しい。

以下の動画でわかるように、液体やガラスを光が透過する時の細かな光の表現が重視されたもの、という印象だ。さらに、「タッチしている部分は光る」という基本原則もある。

これで操作性が劇的に良くなる、というわけでもないとは感じる。過去に作られたアプリの場合、背景の明るさとの関係でUIが見づらくなることもあった。だがこれも、初期デベロッパーベータからパブリックベータになる段階で改善されたものがあり、正式公開版ではまた変わるだろう。

個人的には好みに近い変化だ。ちょっとしたところで「今の透過感、かっこいいな」と思うシーンはある。

負荷の増加を懸念する声もあるが、現時点ではわからない。公開版で判断はできるだろうが、表面的な変化は少ないように思う。

透過は「透明」だけでなく、アイコンの色調整などがセットになっている。色でアイコンを判断することが多いので、個人的には「すべてクリアー調」にする機能は使わないだろうと思っている。しかし、こういう部分で「自分ならではの色調統一」を求める人もいるだろう。

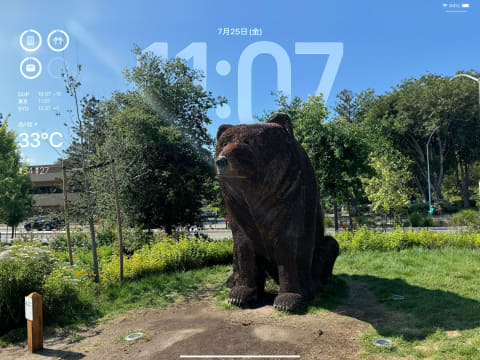

ちなみに、壁紙も細かく変わっている。時間に合わせた色調の変化や、壁紙の内容に合わせて文字との前後関係を変えるなどの工夫がなされている。ただし、細かく自由に変えられるわけではなく、「なんとなくそんな感じになる」くらいの変化と捉えるのが良さそうだ。

その2:カメラアプリのUIが変化

特にUIで言うと、「カメラ」アプリの変化が大きい。

アイコンもいきなりリアルなものに変わったが、メニュー内の表示が非常にシンプルになり、細かな設定は透明なウインドウでオーバーラップする形になっている。

シンプルになった、とポジティブに解釈することもできるが、「静止画と動画以外の切り替えはどこへ行った」と驚くこともあるだろう。

カメラ周りは特に変化が続いており、公開版に向けてまだ修正されるかもしれない。

とにかく、「メニューを左右にスクロールすれば撮影モードが切り替えられる」と覚えておきたい。

その3:特別な機器なしで「写真を立体で楽しむ」機能が登場

特に派手で面白い機能の1つが「写真の立体体験」である。

とりあえず以下の動画をご覧いただきたい。

これは、「写真」アプリ内の写真を立体にして楽しむ「空間シーン」という機能の動画だ。

写真の右上に出る「空間シーン」アイコンをタップすると、写真の奥行きなどが解析されて「立体感のあるデータ」に変わる。あとは、iPhoneなどを持って「動かす」と、動きに合わせて立体感が再現される。上の動画はiPhoneでの例だが、もちろんiPadでもできる。巨大なiPad Proだと、立体感がかなりはっきり出て効果が高い。

立体化する写真はどんなものでもいい。iPhoneで撮影できる「空間写真」とは別のものなので、普通に撮影した写真で問題ない。それどこか、他のデジカメなどで撮影し、「写真」アプリにインポートしたものでも大丈夫だ。

Vision Proには「静止画を立体的な写真にする機能」があった。技術的にはこの応用なのだが、iPhone/iPadのモーションセンサーを使った「空間シーン」に最適化され、独立した機能になっている。

立体化はあくまで推定だ。よく見ると立体構造が崩れていたり、本来はモノに隠れて見えないはずのところを影のように生成して誤魔化していたりする。前傾の動画も、銅像の背景は本来ポスターなのだが、「空間シーン化」の過程でその部分まで立体的に変化し、面白い効果になっている。

同じようなことをするアプリもあるのだが、今後は標準のアプリで、いつ撮影したものでも「空間シーン」になるのが魅力だ。正式版が提供されたら、ぜひ楽しんでみていただきだい。

なお、パブリックベータ版が公開されないので、画像を含めた詳細は紹介できないのだが、Vision Proの「写真を空間化」する機能はさらに進化している。同じような技術を使い、「体ごと写真の世界に入れる」ようになった。もちろん、1枚の写真から立体世界を歩き回れるわけではなく、「写真に頭を突っ込んでちょっと見渡せる」くらいのイメージなのだが。

これはこれでなかなかインパクトの大きな機能だ。

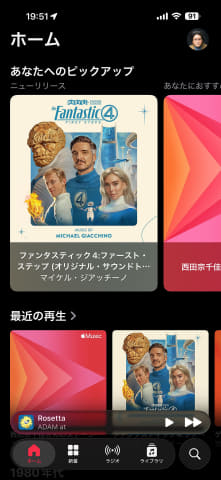

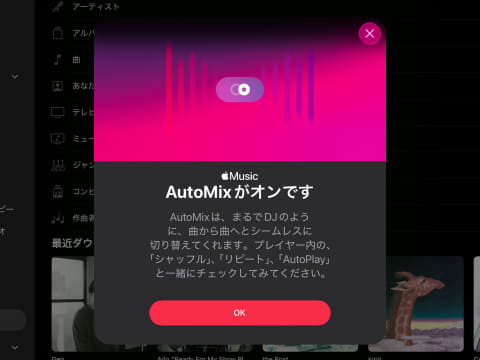

その4:ちょっとしたDJ? 曲を自動でつなぐ「AutoMix」

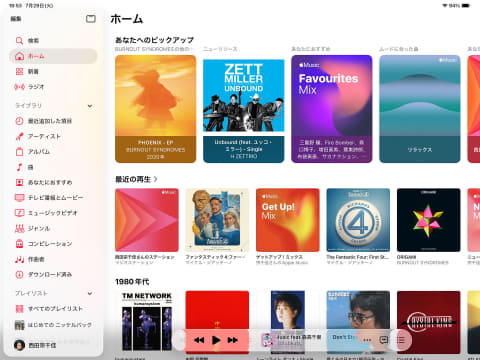

Apple Musicと連動する「ミュージック」にもいくつか変更がある。

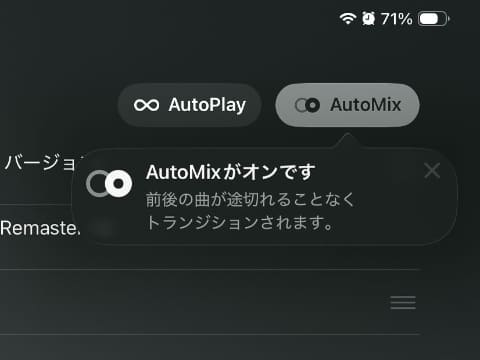

もっとも大きな変更は、曲の切り替わりで使われる「AutoMix」の導入だ。

これは曲のテンポやキー、曲調を判断し、2曲の間をシームレスにつないでくれるものだ。要は、DJがBPMなどを合わせて曲をつなぐ作業と同じようなことをするわけだ。

今も二曲間をフェードイン・アウトで重ねる「クロスフェード」機能は用意されている。それをさらに高度化するのがAutoMix、といえばいいだろうか。

対象はApple Musicの楽曲なので、同サービスへの加入(もしくはフリートライアル)が必須だ。サービスに加入しているなら、Apple Musicからダウンロードした曲でも機能する。飛行機内など、通信ができない場所でも問題ない。

同時に、AutoMix時にはアルバムアート表示もトランジションするようになっている。どんな感じかは以下の動画を見ていただきたい。

新OSへの移行後には、曲間つなぎはAutoMixが基本になっている。クロスフェードとの使い分け、もしくは「曲間つなぎをしない」設定をするには、「ミュージック」アプリの設定を変える必要がある。ただiPadOS 26では、切り替えがより簡単になっている。

AutoMixは、作用・副作用がはっきりした機能のように思う。バッチリいい感じにつないでくれることもあれば、曲の余韻・冒頭を台無しにしてしまうこともある。流石にまだ、人間のDJテクニックには及ばない。

とはいえ、音楽を流しっぱなしにするような場合には良いアクセントにもなる。OSが正式アップデートしたら、ぜひ一度試してみてほしい。

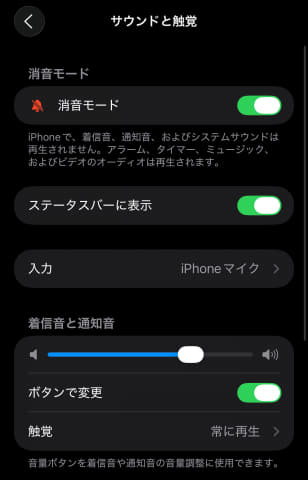

その5:iOS/iPadOSでの「マイク切り替え」が改善

PCやMacに比べ、iOS/iPadOSは自由度が低い。

オーディオ周りで特に気になった不満が、「録音に使うマイク切り替えがわかりづらい」ことだ。BluetoothやUSB-Cで接続したマイクを使う場合、「今どれを使っているのか」「明示的にマイクを切り替えるにはどうすべきか」がわかりづらかった。

しかしiOS 26/iPadOS 26では、「サウンド」の設定の中に、マイク切り替えの設定が追加された。ここから明示的に切り替えられるので、屋外での収録などにはプラスだろう。

アプリ側が対応すれば、撮影アプリからのマイク切り替えもしやすくなるはず。OSアップデート後には、アプリの方のアップデートも確認しよう。

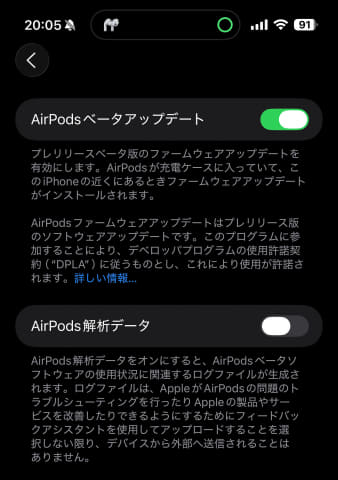

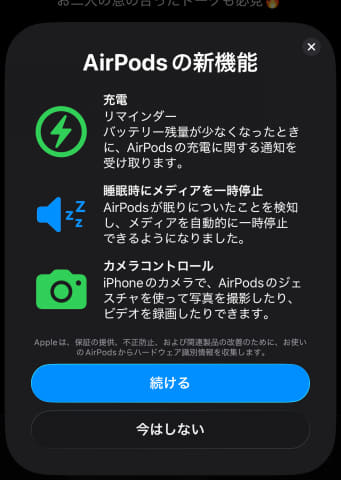

その6:寝落ちしたら自動停止、AirPodsにも機能追加

AirPodsとの連携もいろいろ強化されている。

特に今回は、パブリックベータ版と連動する形で、AirPodsのファームウエアに関してもベータ版を提供する仕組みが設けられた。

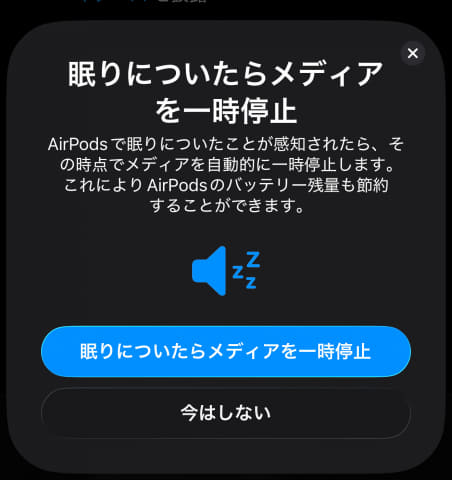

特に大きいのは、つけたまま眠りに落ちた時に再生を停止する機能だ。よくあるシチュエーションだが、寝ている時にも音楽が流れ続けると電力が無駄になる。そのため、「横になっている」「身動きが一定時間止まった」などの要素から睡眠状態を感知し、音楽を自動停止する機能が用意された。もちろん、使うかどうかは利用者次第だ。

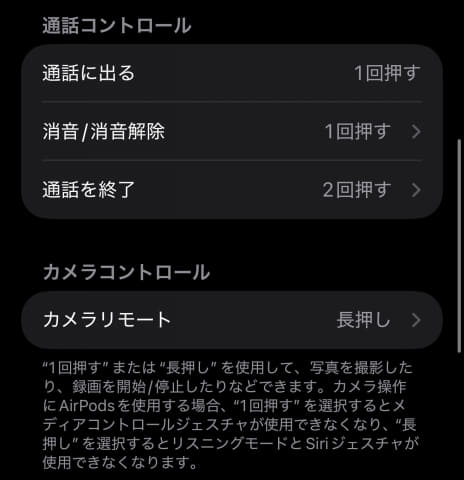

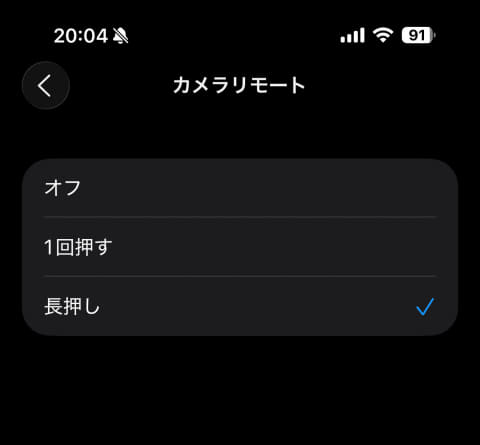

「カメラリモート」も重要な機能だ。iPhoneでカメラアプリを使用中、シャッターを切る動作をAirPodsの動作で行なえるようになった。

なお、カメラリモートについては、Apple Watchとの連動性も上がっている。iPhoneでカメラアプリを開いているとApple Watchにも関連する動作として「カメラリモート」が自動的に呼び出される。これをタップすれば、Apple Watchからシャッターが切れる。機能としては以前からあったものだが、連動性が高まって使いやすくなった。

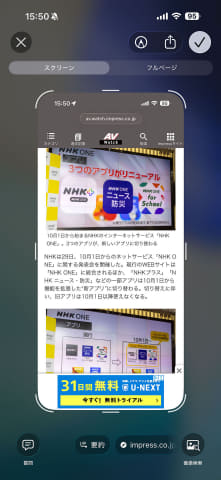

その8:Apple Intelligenceとスクショの連動が強化

アップルのAI機能といえば「Apple Intelligence」。新OS、特にiOS 26では、スクリーンショットをApple Intelligenceで解析する機能の搭載が重要だ。

実はこのため、「スクリーンショットを撮った時」の挙動が変わった。従来はそのまま「写真」アプリへと保存されたが、今回からApple Intelligenceで画像解析をする「Visual Intelligence」の画面を挟む。

「写真」アプリ以外に、「ファイル」アプリへ直接画像ファイルとして保存したり、「メモ」アプリへ保存したりできるという利点はあるが、画像を保存するにはさらに右上をタップして操作しなくてはならず、手間が増えたという見方もできる。

ここでは画面下に注目してほしい。

ChatGPTへ画像全体を送る「質問」、Googleで画像検索をする「画像検索」のほかに、中央に「要約」など、いくつかの項目が出てくる。

この部分はApple Intelligenceが画像を解析し「適切」「必要」と思われる項目が出てくる。だから、ウェブの文章だったら「要約」や「そのページのアドレス」が出てくることになる。

相当賢いのだが、ここになんの項目が出てくるかは、実際に試してみないとわからない。

実は開発者向けの初期ベータ版では、予定の書かれたスクリーンショットを撮ると「カレンダーに記録」というような項目が出てきた。あれは非常に便利な機能だったのだが、現状、パブリックベータ版では出てこなくなっている。最終的にどんなことができるのかは、公開版までの間にまた変化がありそうだ。

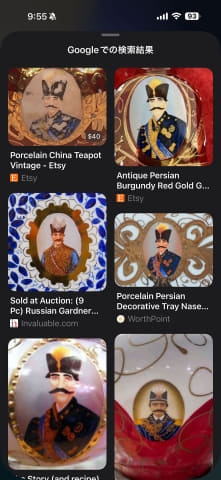

また、スクリーンショットの中で画像検索したい部分を指で囲ったりタップしたりすると、その部分にApple Intelligenceを示すマークが現れ、Googleの画像検索が行なわれる。いってしまえばアップル版「かこって検索」である。

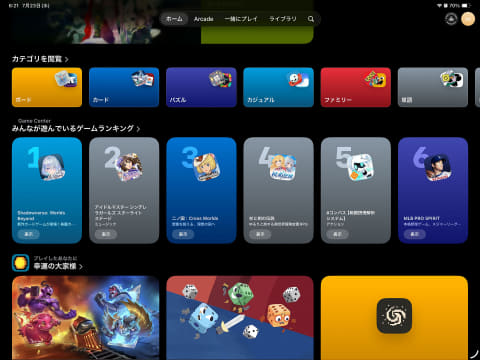

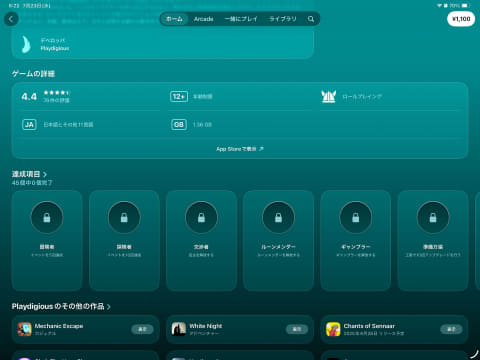

その9:ゲームの再発見を促す「ゲーム」アプリ

アップルのプラットフォーム向けのアプリは「AppStore」を経由して配布される。ゲームについてもAppStoreにタブがあり、そこからダウンロードできる。

新OSからは、これに加え「ゲーム」というアプリが増える。

これは、従来あった「Game Center」を発展させ、アプリダウンロード機能との連動性を強化したものだ。

現在はどのゲームプラットフォーマーも、ゲームの進捗を表す「アチーブメント」や、友人と進行度やスコアを比較する機能を持っている。「ゲーム」アプリはこの要素を取り込んでおり、「友人がどんなゲームをしていて、どこまでスコアを出したか」といった情報から、ゲームへのエンゲージメントを強めることを狙っている。

面白いのは、新しいゲームだけでなく、過去のゲームの「再発見」の役割も担うことだ。新コンテンツやモードの追加などもわかるし、友人のプレイに関する通知が発見を促すこともある。

ゲーム業界的に見れば新しい機能というわけではないが、アップルとして「自社のプラットフォーム内でゲーム市場をより活性化したい」という意識が現れた要素、といえそうだ。