西田宗千佳のRandomTracking

第619回

巨大球体Sphereで、1939年版『オズの魔法使』を16Kの没入体験に。Google CloudがAIで挑戦

2025年4月10日 07:58

Googleのクラウド部門であるGoogle Cloudは、同社の開発者向けイベントである「Google Cloud Next 25」を、4月9日から11日(現地時間)、米ラスベガスで開催する。

その前日、同社はラスベガスにある巨大イベント施設「Sphere」にて発表会を開催した。

そこでは、Sphere向けに、1939年公開の名作映画『オズの魔法使(The Wizard of Oz、日本語タイトル表記は1939年版に基づく)』を、Sphereの16Kスクリーンに合わせたイマーシブな映像へと変化させ、新しい体験を作り出すことが発表された。

そこで活躍するのが、Googleのクラウドと映像生成AI……ということになる。

映像の一般公開は8月28日からだが、それに先駆けて、一部映像の公開と開発の様子が説明された。

今回は「映画をリマスターする1つの方法論としての生成AI」として、GoogleやSphereによる試みを解説する。

なお、本記事内での写真はすべてシアター内を実写したものだが、大きなカメラを持ち込めないという性質上、すべてスマホでの撮影であることをご了承いただきたい。

イマーシブ施設向けに1939年の名作を再構成

Googleのスンダー・ピチャイCEOはイベントにサプライズ登壇し、次のように述べた。

「私たちのゴールは、(ヒロインである)ドロシーやその他のアイコニックなキャラクターたちに、16Kという高解像度な映像によって、新しい光を当てることです。これは歴史的なことになります」

過去に作られた作品のリマスターは、もはや珍しいことではない。映画かテレビ向け作品かでも色々異なるが、一般的には2Kや4K、HDR化などがターゲットということになるだろう。

しかし、『オズの魔法使』のSphere版は大きく違う。

この違いを理解するには、Sphereというのがどういう場所かを理解する必要があるだろう。

Sphereは巨大な半球状のライブ施設だ。詳しくは以下の記事で述べているが、表面積58万平方フィート(約5万3,884平方メートル)、高さは112m、東京ドームの建築面積(4万6,755平方m)の1.15倍という巨大なシアターだ。

内部のシアターはそれより小さな半球状だが、スクリーンは視界全体を覆うように作られており、映像全体では16K(16,384×16,384ピクセル)と圧倒的だ。さらには、座席の振動や風・煙などの演出も加わった「総合イマーシブシアター」といった趣だ。

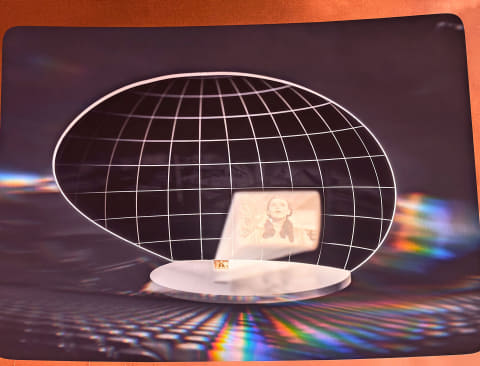

その中で『オズの魔法使』がどのような映像になったのか? まずは以下の写真をご覧いただきたい。

オリジナルの映像から画角が一気に「視界全体」に変わり、ドロシーを演じたジュディ・ガーランドの姿も、まるで現代のカメラで撮影されたかのように鮮明だ。

以下は発表の後半で公開されたカラーパート(『オズの魔法使』は冒頭と最後のシーンがモノクロ、オズの国のパートがテクニカラー撮影)も、驚くような鮮明さだ。

これらはいわゆる3D CGで描き直されたものではなく、オリジナルの4:3画角の映像から、生成AIを使って高解像度化と画角の拡大を実現したものである。

今回の発表では2つほどのシーンしか見ることができなかったが、8月末の一般公開時には、『オズの魔法使』全編がイマーシブな体験として生まれ変わることになる。

1939年版の映画『オズの魔法使』の権利は現在ワーナーブラザーズが持っているが、本映像もSphereとワーナーブラザーズが組み、さらに技術側をGoogleのAI研究部門であるDeepMind、クラウドインフラ部門であるGoogle Cloudが提供、空間演出体験をバーチャルプロダクションなどの技術に長けたMagnopusが担当し、これら5社のタッグで制作が進んでいる。

16K×16Kに拡大、必要な部分は「あらゆる資料と素材」からファインチューン

前出のように、1939年のオリジナル版は画角も解像度も異なる。これをSphere向けにするには、いくつもの変更が必要になる。

まず、解像度を16K×16Kにまで拡大すること。オリジナル版はフィルムだが、当時の映像は鮮明ではない。現在ネット配信されているものも4Kでのマスタリングはされているものの、実質的な解像感はそこまで高くない。

さらに、4:3だった画角を、視界全体を覆うイマーシブな広さに変えること。アスペクト比自体は1:1だが、半球状に視界を覆うことになるので見え方は相当に異なる。すなわち、オリジナル版では「見えていなかった部分」「存在しなかった部分」を作る必要が出てくるのだ。

Google Cloudは動画生成AIである「Veo 2」を持っており、今回のプロジェクトでもこれを使っている。

そうした部分はたしかに生成AIが得意なことではある。しかし、従来のやり方では難しい部分が多々ある。

そこでここでは、Google Cloudの動画生成AIである「Veo 2」をさらにカスタマイズする形で最適化が行なわれた。

この過程ではまず、作品に関する多くの情報で「ファインチューン」が行なわれた。オリジナルフィルムの各シーンはもちろん、撮影に使われたドキュメントや制作中のイメージボード、写真、セットのプランなどに加え、特定のシーンで使われたカメラやレンズ、撮影焦点距離など、非常に多岐に渡る。

さまざまな情報を使ってファインチューンすることで、その当時の作品に重要なテイストやディテールを把握し、そこから逸脱する事なく、解像度と視界の拡張が行なわれる。

「撮影されていない範囲」まで生成AIで補完

解像度を上げる、といったが、『オズの魔法使』の場合、特にカラーパートに課題がある。

『オズの魔法使』は1本のカラーフィルムではなく、三原色ごとに特殊なプリズムで分解、モノクロフィルムに記録する方法が採られた。そのため、色ごとに解像感もノイズの状況も異なり、シンプルに超解像をかけても質が上がりづらい。

そこで、フィルム各色で詳細な超解像が行なわれている。

次に「背景拡張(outpainting)」。

ここまで述べてきたように、視界を広げるということは「オリジナルの映っていないもの」を作るということになる。

AIでの拡張生成は一般的になってきたが、「不自然なものが生成される」「本来その映像にはないであろうものが生成される」という課題がある。

例えば、ドロシーの顔がアップになったシーンがあったとする。そこで視界が広がるということは、顔から下や周囲の風景までを生成して視界を作らなければいけない、ということでもある。

最近は「カメラの動きを意識して動画を生成する」機能を備えたものが増えており、Veo 2もその1つである。

もちろん、それだけでは足りない。

前出のように、大量の情報によるファインチューニングを使って不自然な映像ができることを抑制するのはもちろんだが、他にも配慮すべき点は出てくる。

そのために必要となるのが「パフォーマンス生成」だ。

これは、「シーンがもっと長いカットだったら」「画角がもっと広かったら」という想定のもと、その時に出演者がどんな演技をしているかをAIが推定し、それに合わせて拡張生成を行なう仕組みである。

ここではVeo 2に加えてGeminiが使われる。ディレクションやキャラクターの意図はGeminiで生成され、さらにそこからVeo 2へと連携して画像が作られる。

体験型施設を活かすための巨大プロジェクト

巨大な設備であるSphereは収益性の課題を抱えている。U2やイーグルスなど、ビッグアーティストのライブコンサートを誘致しているが、コンテンツとしてはそれだけでは足りない。

SphereのCEOであるジム・ドーラン氏は、今回のプロジェクトについて次のように述べている。

「Sphereは体験型の施設であり、Sphereの様々な能力を最大限に引き出すことができる作品を探していた。そこに(映画プロデューサーの)ジェーン・ローゼンタール氏がキュレーターとして関わり、プロジェクトが生まれた。彼女との対話の中から、『オズの魔法使』をSphereで上映するというアイデアが生まれた。今回のプロジェクトでは複数の企業を検討したが、最終的にGoogleは唯一無二のパートナーだった」

生成AIを使って作品を再構成することは、ある意味危険なことだ。オリジナル版の制作意図を離れてしまうと、同じ名前の偽物を作り出してしまう可能性も出てくる。

今回のプロジェクトでは、オリジナルの精神を尊重しつつ、前例のない没入型体験を実現するために最新の生成AI技術が活用されている。

Sphere版制作プロジェクトでは、これまでに1.2「ペタバイト」ものデータが使われているという。

全く新しいリマスターのあり方ではあるが、ここまでの規模で展開されるのは、Sphereという特別な場所に対して積極的に投資が行なわれるからでもあり、そこで扱うのが『オズの魔法使』という特別な作品であるからでもある。

これだけ大量のデータを集積し、AIのファインチューンと推論による生成に使うには、当然、巨大かつ高速なクラウドインフラが必要だ。

Google Cloudがこのプロジェクトに参加したのは、DeepMindによる最新の生成AIの必要性だけでなく、巨大なデータを高速に処理できるクラウドインフラをアピールできるから……という意味合いが強い。

たしかに、この規模でプロジェクトを進められる企業は、唯一無二かはともかく、限られているのは間違いない。